WAL/DB Konfiguration in eEKAS (Ceph OSD Optimierung)

Übersicht

In eEKAS sind WAL (Write-Ahead Log) und DB (RocksDB Metadaten) zentrale Komponenten der Ceph OSDs (Object Storage Daemons). Sie dienen der Optimierung von Schreibvorgängen sowie der effizienten Verarbeitung von Metadaten im Storage-Cluster.

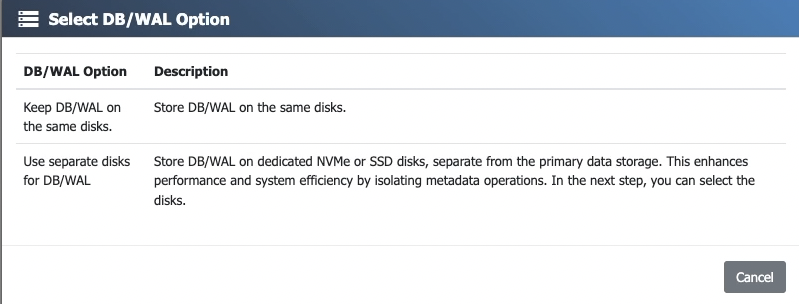

Standardmäßig befinden sich diese Komponenten auf denselben Datenträgern wie die OSD-Daten. eEKAS ermöglicht jedoch den Einsatz von dedizierten WAL/DB-Geräten, wodurch Performance und Stabilität insbesondere in hybriden Umgebungen (z. B. HDD + SSD/NVMe) deutlich verbessert werden können.

Architektur und Funktion

WAL (Write-Ahead Log)

Das WAL speichert Schreiboperationen temporär, bevor sie dauerhaft auf die Daten-OSDs geschrieben werden. Dies stellt die Datenkonsistenz bei unerwarteten Ausfällen sicher und reduziert die Latenz durch effizientere, sequenzielle Schreibvorgänge.

DB (RocksDB Metadaten)

Die DB enthält wichtige Metadaten wie Objektindizes, Placement-Group-Informationen sowie interne Strukturen für schnellen Zugriff und effiziente Verarbeitung.

Ablauf eines Schreibvorgangs

- Eine Schreibanforderung erreicht den OSD

- Die Operation wird zunächst im WAL gespeichert

- Metadaten werden in der DB aktualisiert

- Die Daten werden auf den eigentlichen OSD-Datenträger geschrieben

Vorteile dedizierter WAL/DB-Geräte

Performance

- Geringere Latenz: Schnellere Bestätigung von Schreiboperationen

- Höhere IOPS: Besonders bei kleinen, zufälligen Schreibvorgängen

- Optimierte HDD-Nutzung: Daten auf HDD, Metadaten und Logs auf SSD/NVMe

- Stabileres Verhalten unter Last

Cluster-Effizienz

- Verbesserte Performance bei Rebalancing und Recovery

- Bessere Performance bei metadatenintensiven Workloads

- Vorteilhaft bei Erasure Coding und S3 Object Storage

Konfiguration in eEKAS

Auswahlregeln für Datenträger

Bei der Konfiguration von WAL/DB müssen entweder 2 oder 4 Datenträger pro Node ausgewählt werden:

- 2 Datenträger: RAID 1 (Spiegelung)

- 4 Datenträger: RAID 10 (Striping + Spiegelung)

Wichtig: WAL/DB enthält kritische Metadaten der OSDs. Bei Ausfall ohne RAID-Schutz gehen alle Daten der betroffenen OSDs verloren. Daher ist RAID zwingend erforderlich.

Sizing (Kapazitätsplanung)

Für die Dimensionierung von WAL/DB wird folgende großzügige Mindestempfehlung gegeben:

Minimale WAL/DB-Kapazität = Anzahl OSDs pro Node × 50 GB

Formel:

WAL/DB Kapazität pro Node = Anzahl OSDs × 50 GB

Empfehlung: Diese großzügige Mindestgröße stellt ausreichend Reserve für Metadatenwachstum, Recovery-Prozesse und metadatenintensive Workloads (z. B. S3 oder viele kleine Dateien) sicher.

Beispiele

- 8 OSDs → mindestens 400 GB

- 12 OSDs → mindestens 600 GB

- 24 OSDs → mindestens 1200 GB

Bei der Auswahl von 2 oder 4 WAL/DB-Disks muss sichergestellt werden, dass die nutzbare RAID-Kapazität diese Anforderungen erfüllt.

Risiken und Hinweise

Ohne ausreichenden Schutz

- Verlust von WAL/DB führt zum Verlust von Metadaten

- OSDs werden unbrauchbar

- Alle Daten der betroffenen OSDs gehen verloren

- Neuaufbau und Rebalancing erforderlich

Fehlkonfiguration

- Langsame Datenträger reduzieren den Performance-Vorteil

- Zu geringe Kapazität kann Performance-Probleme verursachen

- Gemischte Medien können zu inkonsistentem Verhalten führen

Best Practices

- Enterprise SSD oder NVMe verwenden

- Hohe IOPS und geringe Latenz bevorzugen

- Einheitliche Hardware pro Cluster einsetzen

- Zusätzliche Reserve für S3, Erasure Coding und viele kleine Objekte einplanen

Zusammenfassung

Dedizierte WAL/DB-Geräte verbessern Performance und Stabilität von Ceph-Clustern erheblich. Durch die Auslagerung von Metadaten und Log-Operationen auf schnelle Medien wird das Gesamtsystem effizienter und reaktionsschneller.

Da diese Komponenten kritische Metadaten enthalten, ist RAID-Schutz zwingend erforderlich. Als einfache und sichere Planungsregel sollten mindestens 50 GB WAL/DB pro OSD eingeplant werden.